一文读懂OrangePi AIpro体验测评与应用开发

OrangePi AIpro采用昇腾AI技术路线,具体为4核64位处理器+AI处理器,集成图形处理器,支持8TOPS AI算力,拥有8GB/16GB LPDDR4X, Orange Pi AIpro引用了相当丰富的接口。可广泛适用于AI边缘计算、深度视觉学习及视频流AI分析、视频图像分析、自然语言处理、智能小车、机械臂、人工智能、无人机、云计算、AR/VR、智能安防、智能家居等领域,覆盖 AIoT

文章目录

OrangePi AIpro 基本介绍

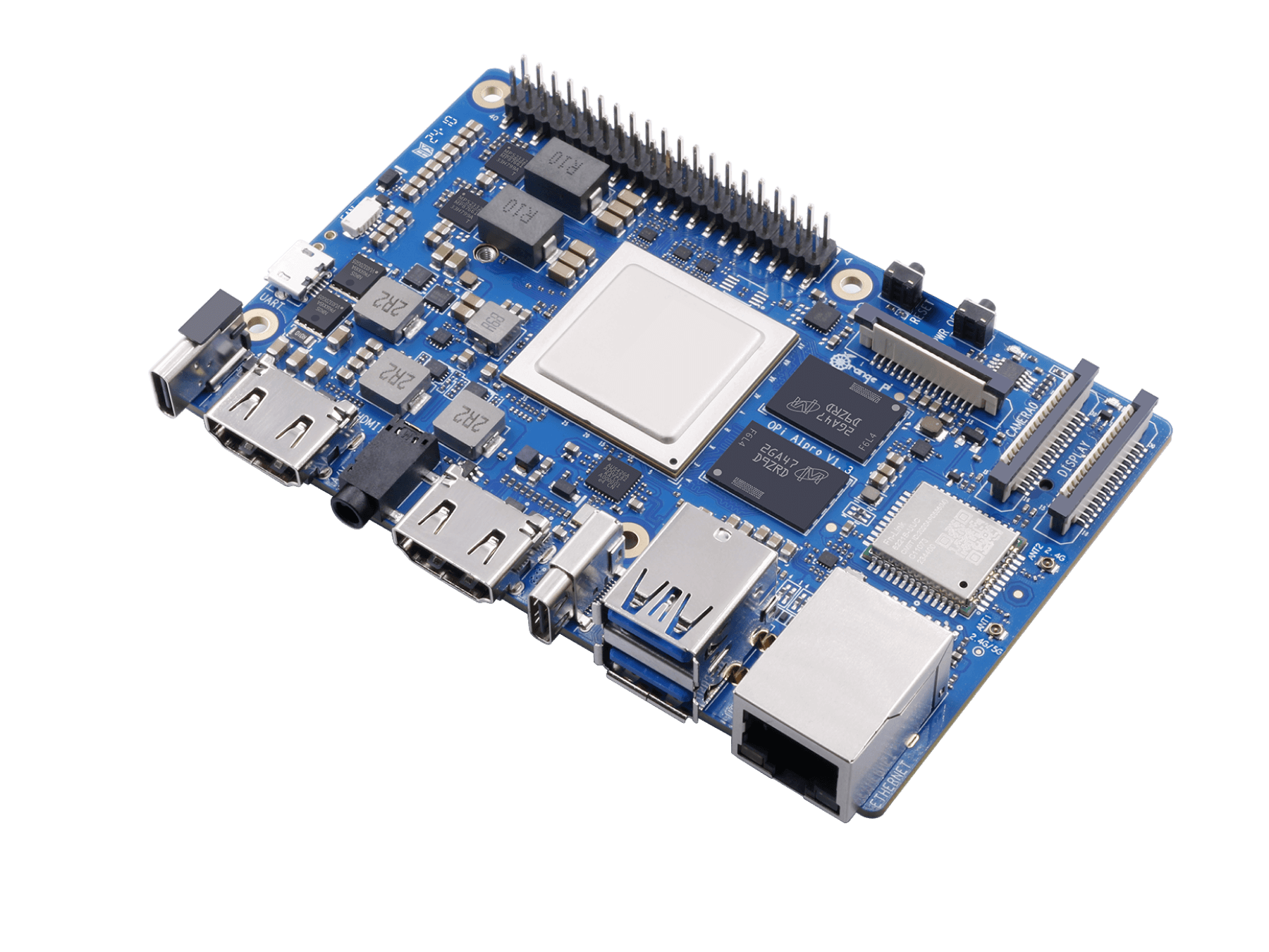

OrangePi AIpro采用昇腾AI技术路线,具体为4核64位处理器+AI处理器,集成图形处理器,支持8TOPS AI算力,拥有8GB/16GB LPDDR4X,可以外接32GB/64GB/128GB/256GB eMMC模块,支持双4K高清输出。 Orange Pi AIpro引用了相当丰富的接口,包括两个HDMI输出、GPIO接口、Type-C电源接口、支持SATA/NVMe SSD 2280的M.2插槽、TF插槽、千兆网口、两个USB3.0、一个USB Type-C 3.0、一个Micro USB(串口打印调试功能)、两个MIPI摄像头、一个MIPI屏等,预留电池接口,可广泛适用于AI边缘计算、深度视觉学习及视频流AI分析、视频图像分析、自然语言处理、智能小车、机械臂、人工智能、无人机、云计算、AR/VR、智能安防、智能家居等领域,覆盖 AIoT各个行业。 Orange Pi AIpro支持Ubuntu、openEuler操作系统,满足大多数AI算法原型验证、推理应用开发的需求。

AI边缘计算产品对比

从产品的定位来看, OrangePi AIpro定位是打造高性能AI边缘计算设备。同品类的其他厂商设备主要有NVIDIA Jetson TX1/TX2系列等边缘计算产品。

同类产品参数对比: 整体来看OrangePi AIpro 还是一款性价比很高的AI边缘计算产品

| 参数 | OrangePi AIpro | OrangePi AIpro New | Jetson TX2 | Jetson Xavier NX | Jetson AGX Orin |

|---|---|---|---|---|---|

| AI算力 | 8 TOPS(INT8) // 4 TFLOPS(FP16) | 20 TOPS | 1.33 TFLOPS | 21 TOPS | 275 TOPS |

| GPU | 华为昇腾 AI处理器 | 华为昇腾 AI处理器 | 256 核 NVIDIA Pascal™ 架构 | 48 个 Tensor Core 的 384 核 NVIDIA Volta™ 架构 | 64 个 Tensor Core 的 2048 核 NVIDIA Ampere 架构 |

| CPU | 4 核 64 位 ARM 处理器 | * 核 64 位 ARM 处理器 | 4核 ARM ® Cortex®-A57 MPCore | 6 核 NVIDIA Carmel Arm® v8.2 | 12 核 Arm® Cortex® A78AE v8.2 |

| 内存 | 8GB 或 16GB LPDDR4X | 12GB 或 24GB LPDDR4X | 4GB 或 8GB LPDDR4 | 8GB 或 16GB LPDDR4X | 32GB 或 64GB LPDDR5 |

| 存储 | 可外接 eMMC / NVMe SSD / SATA SSD | 16/32GB eMMC 5.1 | 16/32GB eMMC 5.1 | 64GB eMMC 5.1 | |

| 其他外设 | 蓝牙/WIFI/以太网/USB/HDMI/MIPI CSI摄像头 | 蓝牙/WIFI/以太网/USB/HDMI/MIPI CSI摄像头 | WIFI/以太网/USB/HDMI/MIPI CSI摄像头 | WIFI/以太网/USB/HDMI/MIPI CSI摄像头 | WIFI/以太网/USB/HDMI/MIPI CSI摄像头 |

| 价格 | 860元 | 1500元 | 1260元 | 3360元 | 13900元 |

性能测试体验

- Orange Pi AIpro支持Ubuntu、openEuler操作系统,满足大多数AI算法原型验证、推理应用开发的需求。

1. 点亮系统

-

开发板支持从 TF 卡、eMMC 和 SSD(支持 NVMe SSD 和 SATA SSD)三种模式启动。

-

这里使用的是 Orange Pi AIpro 默认在32G TF卡刷了 Ubuntu 22.04.4 LTS (GNU/Linux 5.10.0+ aarch64)

-

系统有4个CPU核 默认设置 Control CPU : AI CPU = 3 : 1

-

可以根据的应用场景,设置对应的CPU比例模式

sudo npu-smi set -t cpu-num-cfg -i 0 -c 0 -v 0:4:0 // 4个Control CPU

sudo npu-smi set -t cpu-num-cfg -i 0 -c 0 -v 0:2:2 // 2个Control CPU

# 查询 CPU设置命令

npu-smi info -t cup-num-cfg -i 0 -c 0

Current AI CPU number : 1

Current control CPU number : 3

Current data CPU number : 0

watch -n 1 npu-smi info -t usages -i 0 -c 0

Memory Capacity(MB) : 7545

Memory Usage Rate(%) : 26

Hugepages Total(page) : 15

Hugepages Usage Rate(%) : 100

Aicore Usage Rate(%) : 0

Aicpu Usage Rate(%) : 0

Ctrlcpu Usage Rate(%) : 1

Memory Bandwidth Usage Rate(%) : 0

2. Jupyter远程启动测试官方例程

cd ~/samples/notebooks

bash start_notebook.sh 192.168.0.108 # 设置为自己系统对应的ip

3. 官方例程在OrangePi AIpro上的运行效果

1. YOLOv5 目标检测

- YOLOv5系列中较为轻量的网络,适合在边缘设备部署,进行实时目标检测。

- 从测试效果看设备的 Control CPU 、AI CPU、以及Memory的占用都是比较低的。

yolo5 模型运行效果

2. OCR 识别

- 这里测试的OCR模式为:检测模型为CTPN,识别模型则是SVTR

- CTPN模型基于Faster RCNN模型修改而来,而SVTR则基于近几年十分流行的Vision Transformer模型

- 测试结果来看 单帧推理的速度 0.43s, 复杂一些的图片推理, 时间为1.57s

![[图片]](https://i-blog.csdnimg.cn/blog_migrate/cd9e7c4322828e3866a44ac5a9f12da6.png)

3. ResNet50 物体检测

- 这里测试的是一个 resnet50.caffemodel

- 进行模型转换后测试单帧图像检测的速度为48ms, 速度还是很快的。

atc --model=resnet50.prototxt --weight=resnet50.caffemodel --framework=0 --output=resnet50 --input_format=NCHW --soc_version=Ascend310B1 --input_fp16_nodes=data --output_type=FP32 --out_nodes=prob:0

4. 图像增强模型测试

- 初始化acl资源:在调用acl相关资源时,必须先初始化AscendCL,否则可能会导致后续系统内部资源初始化出错。

- 对输入进行预处理:包括图像归一化、缩放、颜色转换操作。

- 推理:利用AclLiteModel.execute接口进行推理。

- 对推理结果进行后处理:包括形状变换、缩放、颜色转换操作,保存增强后图像。

![[图片]](https://i-blog.csdnimg.cn/blog_migrate/770b32f5c45b0c49a4e2d3fc7a9d8173.png)

5 CartoonGAN 图像风格迁移

- 初始化acl资源:在调用acl相关资源时,必须先初始化AscendCL,否则可能会导致后续系统内部资源初始化出错。

- 对图片进行前处理:在此样例中,我们首先根据图片路径,构造AclLiteImage类型的数据,再利用.jpegd和.crop_and_paste_get_roi转换图片格式、裁剪图片。注意由于模型输入是yuv格式,所以我们利用了AclLiteImageProc.jpegd将图片转为yuv,使得模型正常推理。

- 推理:利用AclLiteModel.execute接口对图片进行推理。

- 对推理结果进行后处理:包括两个步骤,即转换像素值值域以及将图片缩放到原图大小

总结

- 整体来看OrangePi AIpro 还是一款性价比很高的AI边缘计算产品,正常的CPU运算和边缘端的AI推理都能很好的支持,比较适合AI硬件开发。

- 依托华为昇腾的生态,能够方便各类主流模型的迁移和转化,方便各类AI应用的部署和应用。

参考文档

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)