【Kubernetes】k8s的svc所有概念和实操详细说明(含镜像和代码)【1】【svc作用是端口转发相关】

文章目录service【svc】Service 的概念service介绍service网络服务模式【概念】ClusterIp 【内部访问】NodePort【外部访问】LoadBalancer【外部负载均衡】ExternalName【直达模式】特别说明service网络服务模式【实现】ClusterIP【内部访问】Headless Service【无头服务,无头服务也是一种Cluster IP,只不

service【svc】

Service 的概念

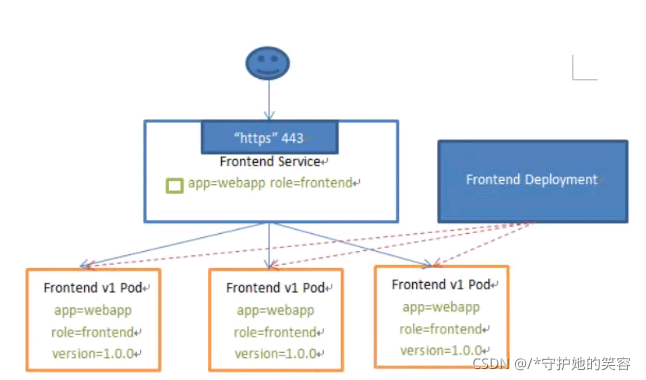

- Kubernetes Service定义了这样一种抽象:一个Pod的逻辑分组,一种可以访问它们的策略 —— 通常称为微服务。这一组Pod能够被Service访问到,通常是通过Label Selector

- Service能够提供负载均衡的能力,但是在使用上有以下限制:

只提供 4 层负载均衡能力,而没有 7 层功能,但有时我们可能需要更多的匹配规则来转发请求,这点上 4 层负载均衡是不支持的

service介绍

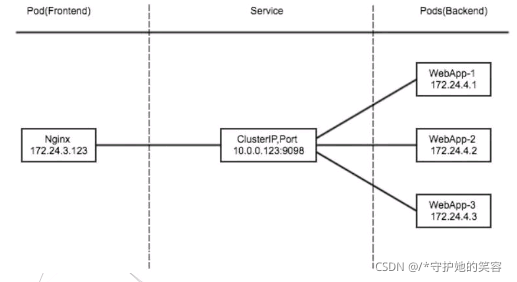

- Service(简称svc)定义了Pod的逻辑集合和访问该集合的策略,是真实服务的抽象。Service提供了一个统一的服务访问入口以及服务代理和发现机制,用户不需要了解后台Pod是如何运行。Service通过Label找到Pod组。因为Service是抽象的,所以在图表里通常看不到它们的存在,这也就让这一概念更难以理解。

- svc在整个集群中负责网络服务(并不是底层容器网络实现),因为pod实际上是不可靠的,可能会被停止或者重启,一旦重启就会导致IP地址发生变化,SVC的功能就是使用kube-proxy进行网络的控制,pod的IP发生变化上层业务并不会中断,kube-proxy采用负载均衡等策略实现网络服务。

- 例如通过定义一个RC启动了4个pod,如何让外部能优雅的调用到这几个pod提供的服务?由于pod的IP地址可能随时发生变化(pod不健康或期间被重启或被重建等),在pod的外层使用nginx等进行负载也就不太方便了,而Service 就是解决这个问题而存在的:可以根据pod的标签将对应的所有pod纳入一个负载均衡组的形式,通过kube-proxy 进行数据转发,提供一个外部到pod的唯一入口而不用关心pod的变动,进而实现和外部的调用通信。

service网络服务模式【概念】

Service 在 K8s 中有以下四种类型

ClusterIp 【内部访问】

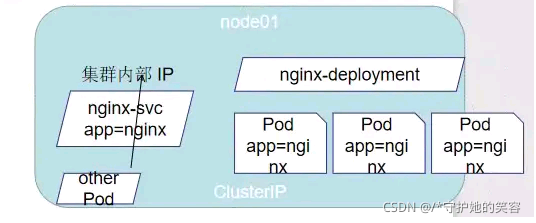

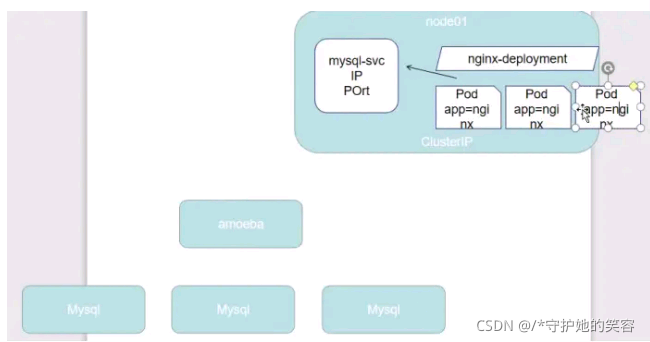

ClusterIp:默认类型,自动分配一个仅 Cluster 内部可以访问的虚拟 IP【service创建一个仅集群内部可访问的ip,集群内部其他的pod可以通过该服务访问到其监控下的pod】

NodePort【外部访问】

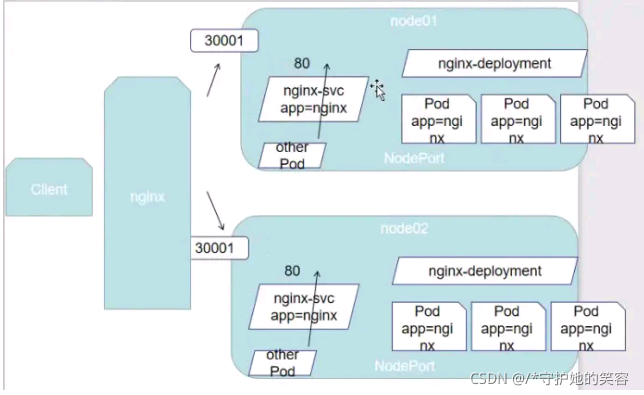

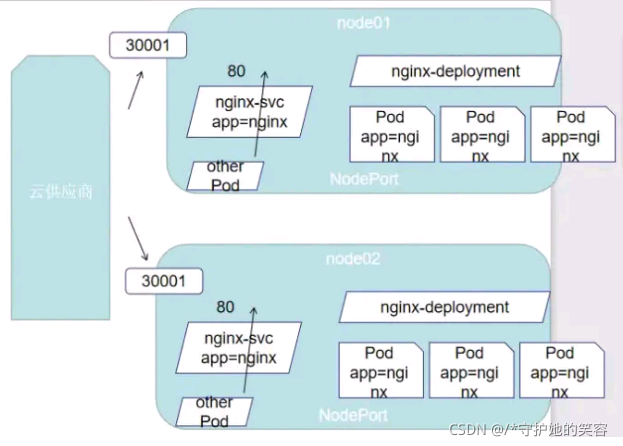

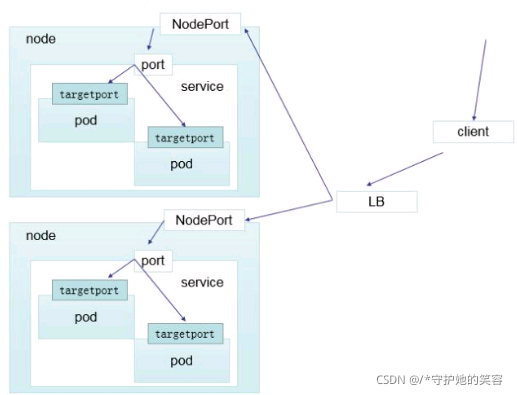

NodePort:在 ClusterIP 基础上为 Service 在每台机器上绑定一个端口,这样就可以通过:NodePort 来访问该服务【在service及各个node节点上开启端口,外部的应用程序或客户端访问node的端口将会转发到service的端口,而service将会依据负载均衡随机将请求转发到某一个pod的端口上。一般暴露服务常用的端口】

LoadBalancer【外部负载均衡】

LoadBalancer:在 NodePort 的基础上,借助 cloud provider 创建一个外部负载均衡器,并将请求转发到: NodePort【在NodePort基础之上,即各个节点前加入了负载均衡器实现了真正的高可用,一般云供应商提供的k8s集群就是这种】

ExternalName【直达模式】

④ ExternalName:把集群外部的服务引入到集群内部来,在集群内部直接使用。没有任何类型代理被创建,这只有 kubernetes 1.7 或更高版本的 kube-dns 才支持【当我们的集群服务需要访问k8s之外的集群时,可以选择这种类型,然后把外部服务的IP及端口写入到k8s服务中来,k8s的代理将会帮助我们访问到外部的集群服务】

特别说明

- Service 创建网络服务一般分为集群内部访问(clusterIP )和集群外部访问(NodePort)模式:

- 内部访问clusterIP 的方式会创建一个虚拟IP地址,该地址没有基于某个实际网卡创建,所以在宿主机上是无法访问的,仅能在集群内部访问,也就是在容器内部访问;

- 外部访问NodePort 是通过映射端口到宿主机的方式,访问地址为宿主机IP地址加上端口的方式,和hostPort 类似,但是NodePort 会在kubernetes集群的所有node上监听,也就是说创建一个Service ,配置了一个NodePort 监听30000端口,那么集群内所有的node都会监听30000端口,不管访问该node上有没有对应的pod,随意访问任何一台node的30000端口都可以被转发到正确的后端pod中;

service网络服务模式【实现】

这个实现只是代码简单说明【具体流程去看我的service实操】,里面有详细说明

ClusterIP【内部访问】

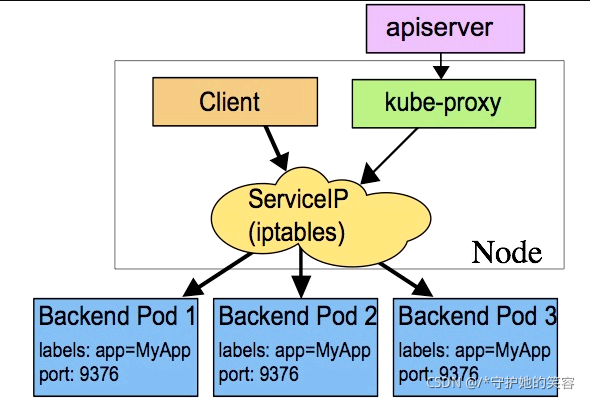

-

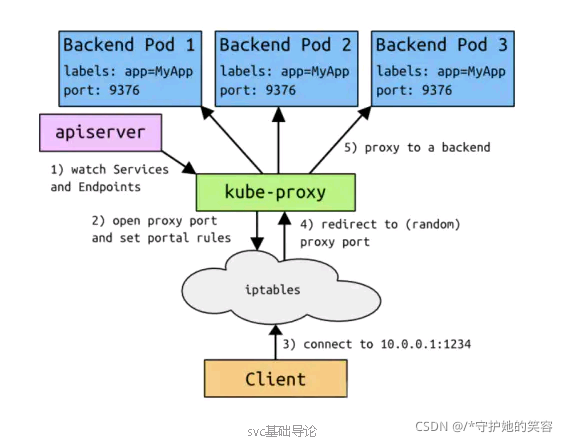

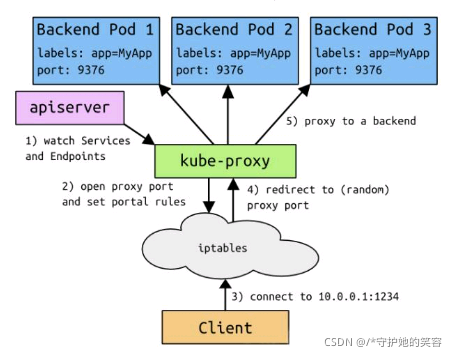

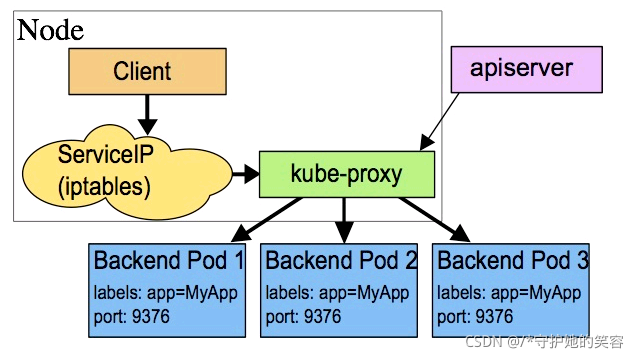

clusterIP主要在每个node节点使用iptables【新版本模式是ipvs代理模式因此此处为ipvs,代理模式不同所使用的底层方案也是不一致的】,将发向clusterlP对应端口的数据,转发到kube-proxy中。然后kube-proxy自己内部实现有负载均衡的方法,并可以查询到这个service下对应pod的地址和端口,进而把数据转发给对应的pod的地址和端口

-

为了实现图上的功能,主要需要以下几个组件的协同工作:

apiserver用户通过kubectl命令向apiserver发送创建service的命令,apiserver接收到请求后将数据存储到etcd中kube-proxy kubernetes的每个节点中都有一个叫做kube-porxy的进程,这个进程负责感知service,pod的变化,并将变化的信息写入本地的iptables规则中iptables使用NAT等技术将virtuallP的流量转至endpoint中

-

资源清单示例:

㈠创建一个Deployment

apiVersion: apps/v1

kind: Deployment

metadata:

name: myapp-deploy

namespace: default

spec:

replicas: 3

selector:

matchLabels:

app: myapp

release: stabel

template:

metadata:

1abels:

app: myapp

release: stabel

env: test

spec:

containers:

- name: myapp

image: fanqisoft/myapp:v2

imagePullPolicy: IfNotPresent

ports:

- name: http

containerPort: 80

apiVersion: v1

kind: Service

metadata:

name: myapp

namespace: default

spec:

type: ClusterIP

selector:

app: myapp

release: stabel

ports:

- name: http

port: 80

targetPort: 80

Headless Service【无头服务,无头服务也是一种Cluster IP,只不过是一种特殊的Cluster IP】

- 有时不需要或不想要负载均衡,以及单独的Service IP。遇到这种情况,可以通过指定 ClusterIP(spec.clusterIP)的值为“None”来创建 Headless Service。这类Service 并不会分配 Cluster IP,kube-proxy 不会处理它们,而且平台也不会为它们进行负载均衡和路由

- 主要的特点是通过无头服务的方式去解决hostname和portname的变化问题,也就是通过它去进行绑定

apiVersion: v1

kind: Service

metadata:

name: myapp-headless

namespace: default

spec:

selector:

app: myapp

clusterIP: "None"

ports:

- port: 80

targetPort: 80

- 对于svc,一旦创建成功以后,它会写入到coreDNS中去,我们的svc的创建会有一个主机名会被写入到coreDNS,写入的格式体就是 svc的名称+命名空间的名称+当前集群的域名

yum -y install bind-utils

dig -t A myapp-headless.default.svc.cluster.local. @10.96.0.10

- 意味着在无头服务中,虽然它没有ip了,但可以通过访问域名的方案依然可以访问服务下的pod

NodePort【外部访问】

- nodePort的原理在于在node上开了一个端口,将向该端口的流量导入到kube-proxy,然后由 kube-proxy进一步到给对应的pod

apiVersion: v1

kind: Service

metadata:

name: myapp

namespace: default

spec:

type: NodePort

selector:

app: myapp

release: stabel

ports:

- name: http

port: 80

targetPort: 80

- 查询流程

iptables -t nat -nvL

KUBE-NODEPORTS

LoadBalancer【外部负载均衡】

- loadBalancer和nodePort 其实是同一种方式。区别在于 loadBalancer 比nodePort多了一步,就是可以调用cloud provider【云供应商】 去创建LB【负载均衡】来向节点导流

ExternalName【直达模式】

- 这种类型的 Service 通过返回 CNAME和它的值,可以将服务映射到externalName字段的内容(例如:hub.coreqi.cn)。ExternalName Service 是Service的特例,它没有 selector,也没有定义任何的端口和Endpoint。相反的,对于运行在集群外部的服务,它通过返回该外部服务的别名这种方式来提供服务

apiVersion: v1

kind: Service

metadata:

name: my-service

namespace: default

spec:

type: ExternalName

externalName: hub.coreqi.cn

当查询主机 my-service.defalut.svc.cluster.local(SVC_NAME.NAMESPACE.svc.cluster.local)时,集群的DNS 服务将返回一个值my.database.example.com的CNAME记录。访问这个服务的工作方式和其他的相同,唯一不同的是重定向发生在DNS层,而且不会进行代理或转发。

实现原理

- 总结:

- 客户端访问节点【pod】时通过iptables实现的

- iptables规则是通过kube-proxy写入的

- apiserver通过监控kube-proxy去进行对服务和端点的监控

- apiserver通过监控kube-proxy去实现服务端点信息的发现

- kube-proxy通过pod的标签(lables)去判断这个断点信息是否写入到Endpoints里去

- kube-proxy:通过选择标签去监控对应的pod并写入到iptable规则里面去

- 客户端访问服务时通过iptables中的规则被定向到pod的地址信息

k8s代理模式的分类

VIP 和 Service 代理

- 在Kubernetes集群中,每个Node 运行一个kube-proxy 进程。kube-proxy负责为service 实现了一种VIP(虚拟IP)的形式【可以在集群内部直接访问】,而不是ExternalName【返回集群外部的地址信息】 的形式。在Kubernetes v1.0版本,代理完全由userspace实现。在Kubernetesv1.1版本,新增了iptables代理,但并不是默认的运行模式。从Kubernetesv1.2起,默认就是iptables 代理。在Kubernetes v1.8.0-beta.0中,添加了ipvs代理

- 在Kubernetes 1.14版本开始默认使用ipvs代理

- 在Kubernetes v1.0版本,service是“4层”(TCP/UDP over IP)概念。在Kubernetes v1.1版本,新增了IngressAPI(beta版),用来表示“7层”(HTTP)服务!可以进行7层的负载均衡。正是因为有了Ingress的API接口,我们才有了7层调度的功能。

为何不使用 round-robin DNS?

k8s不管是历史还是现在都没有使用过DNS,不采用DNS负载均衡集群,最大最有意义的一点就是DNS会在很多的客户端里进行缓存,很对服务访问DNS进行域名解析的时候解析完成以后得到地址以后很多的服务都不会对DNS的缓存进行清除,也就意味着只要缓存存在服务在下次访问的时候还是这个地址信息,因此也就达不到我们负载均衡的要求了,因此DNS一般仅仅作为负载均衡的一种辅助手段

userspace代理模式

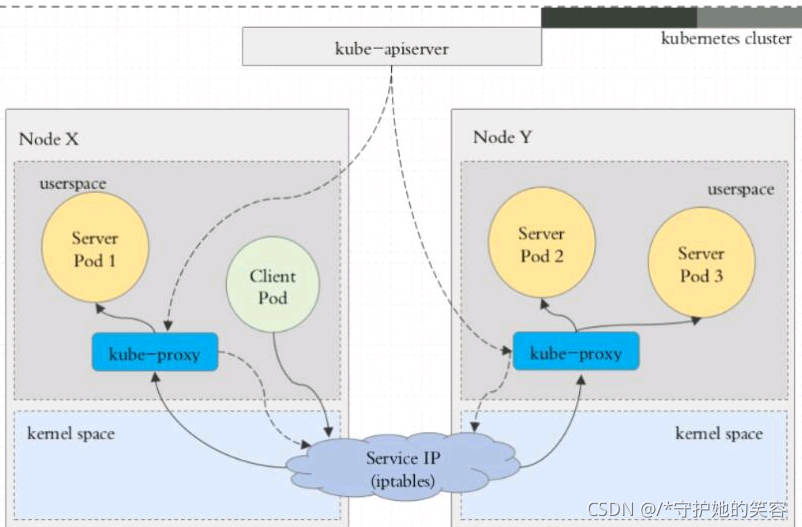

- 客户端首先访问iptables通过iptables访问到kube-proxy然后访问到具体的pod上

也就是说每次访问的时候都需要Kube-proxy进行一次代理

也就是说kube-proxy压力是非常大的

同时kube-apiserver也会监控kube-proxy服务更新及端点的维护

- 这种模式,kube-proxy会监视Kubernetes master对service对象和Endpoints对象的添加和移除。对每个Service,它会在本地Node上打开一个端口(随机选择)。任何连接到“代理端口”的请求,都会被代理到Service的backend Pods中的某一个上面(如 Endpoints 所报告的一样)。使用哪个backend Pod,是基于Service的SessionAffinity来确定的。最后,它安装iptables规则,捕获到达该Service的clusterIP(是虚拟IP)和Port的请求,并重定向到代理端口,代理端口再代理请求到backend Pod。

网络返回的结果是,任何到达Service的IP:Port的请求,都会被代理到一个合适的backend,不需要客户端知道关于Kubernetes,service或pod的任何信息。

默认的策略是,通过round-robin算法来选择backend Pod。实现基于客户端IP的会话亲和性,可以通过设置service.spec.sessionAffinity的值为“ClientIP”(默认值为“None”);

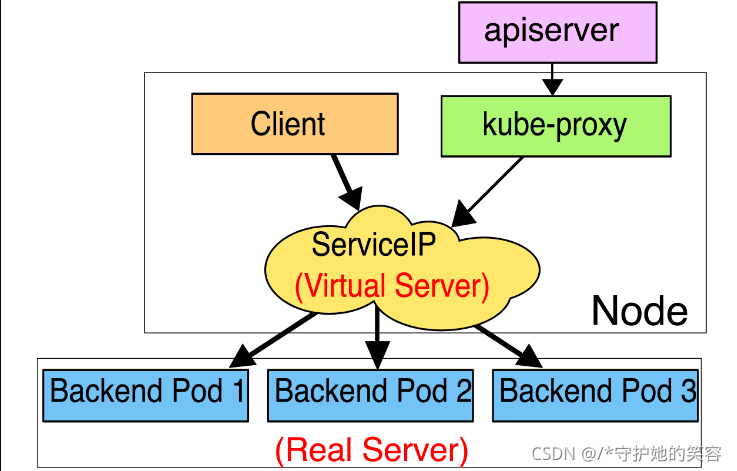

iptables代理模式

- 注:kube-proxy模式是iptables,则ping不通svc的地址【但端口可以通】

- 舍弃掉了kube-proxy,所有访问直接通过iptables而不需要kube-proxy去调度,这样的话访问速度就会大大增加以及kube-proxy稳定性会提高压力将会减少很多, 当然使用iptables(防火墙)性能并不会怎么高,但除此之外几乎没有什么缺点。

kube-apiserver依然通过监控kube-proxy去实现iptables的端口的更新维护

- 这种模式,kube-proxy会监视Kubernetes master对象和Endpoinnts对象的添加和移除。对每个Service,它会安装iptables规则,从而捕获到达该Service的clusterIP(虚拟IP)和端口的请求,进而将请求重定向到Service的一组backend中某个上面。对于每个Endpoints对象,它也会安装iptables规则,这个规则会选择一个backend Pod。

默认的策略是,随机选择一个backend。实现基于客户端IP的会话亲和性,可以将service.spec.sessionAffinity的值设置为“ClientIP”(默认值为“None”)

和userspace代理类似,网络返回的结果是,任何到达Service的IP:Port的请求,都会被代理到一个合适的backend,不需要客户端知道关于Kubernetes,service或Pod的任何信息。这应该比userspace代理更快,更可靠。然而,不想userspace代理,如果始出选择的Pod没有响应,iptables代理不能自动地重试另一个Pod,所以它需要依赖readiness probes;

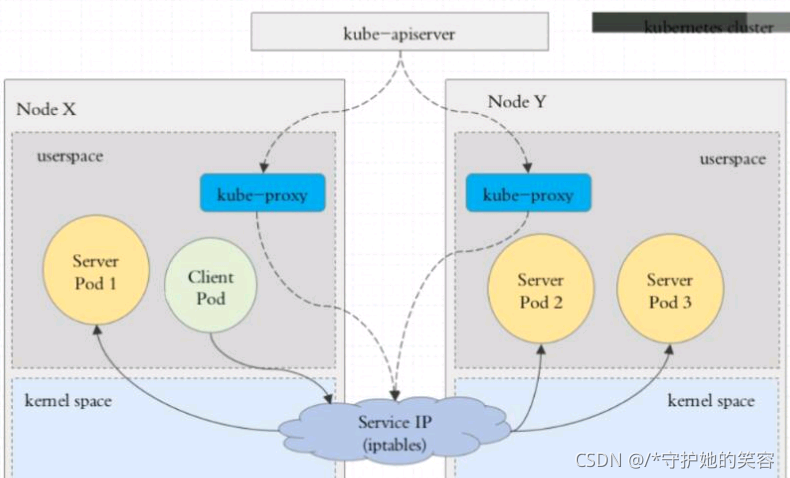

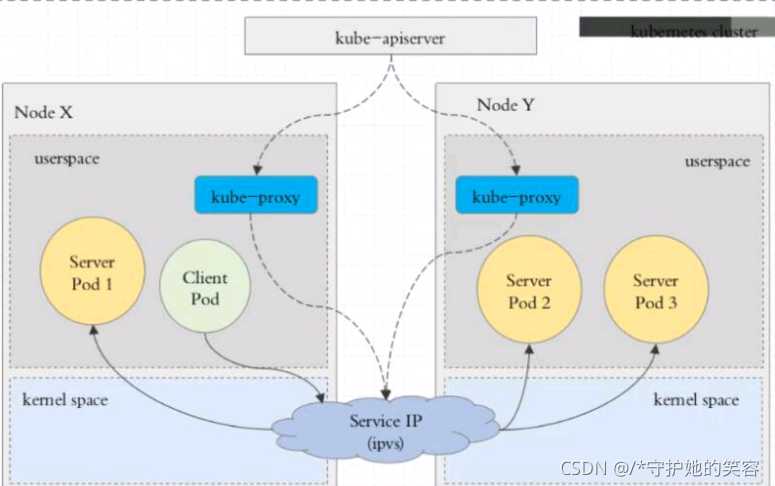

ipvs代理模式

-

kube-proxy模式是ipvs,则能ping 通svc的地址【仅限集群内部ip可以ping通】

-

将iptables代理模式中iptables变更为ipvs,原来是把所有的调度规则通过iptables进行所谓的服务转发定向的变成了通过ipvs模块去实现负载均衡以及流量导向,并且和iptables代理模式相同,所有的访问也是不经过kube-proxy的,如果没有提前安装ipvs模块以及一些基本需求没有完成,那些k8s将会使用iptables的代理模式

-

ipvs这种模式,kube-proxy会监视Kubernetes service 对象和Endpoints,调用netlink 接口以相应地创建ipvs 规则并定期与Kubernetes service对象和Endpoints 对象同步ipvs规则,以确保ipvs状态与期望一致。访问服务时,流量将被重定向到其中一个后端 Pod

-

与iptables类似,ipvs于netfilter的hook功能,但使用哈希表作为底层数据结构并在内核空间中工作。这意味着ipvs可以更快地重定向流量,并且在同步代理规则时具有更好的性能。此外,ipvs为负载均衡算法提供了更多选项,例如:

- rr:轮询调度

- 1c:最小连接数

- dh:目标哈希

- sh:源哈希

- sed:最短期望延迟

- nq:不排队调度

-

注意: ipvs模式假定在运行kube-proxy之前在节点上都已经安装了IPVS内核模块。当kube-proxy以ipvs代理模式启动时,kube-proxy将验证节点上是否安装了IPVS模块,如果未安装,则kube-proxy将回退到iptables代理模式

#查看ipvs代理规则

ipvsadm -Ln

service实操

更多推荐

已为社区贡献16条内容

已为社区贡献16条内容

所有评论(0)